这几天的技术新闻,为什么都在围着“算力、代理、成本”打转

如果把 4 月下旬这几天 AI 和云计算圈的消息放在一起看,会发现行业讨论已经不只是“哪个模型更强”了,而是慢慢转向三个更现实的问题:算力要不要自己掌控、AI 代理怎么真正落地到企业环境、以及云资源成本会不会继续抬高。这三个问题看起来分散,实际上是一条线上的前后环节。模型能力往前冲,企业落地就会更依赖稳定算力、可控平台和可承受的费用。

最近几天公开信息里,最受关注的一条,是 4 月 18 日多家媒体整理提到的 OpenAI 与 Cerebras 达成长期合作,方向是更大规模地采购芯片服务器、强化算力侧自主能力。这个动作的意义不只是“买更多机器”,更像是在给行业释放一个信号:当大模型进入高频调用、Agent 持续执行、企业级工作流越来越长之后,算力已经不是后台配角,而是决定成本和交付速度的核心资产。

第一条主线:头部厂商开始更认真地算“算力账”

过去大家聊 AI 基础设施,容易把注意力放在 GPU 数量、训练参数、谁先上新模型上。但这几天的新闻更像是在提醒市场:真正拉开差距的,也许不是谁喊得更大声,而是谁能更稳定地拿到算力、把推理成本压下来,并且在供应链紧的时候不被卡住。4 月 18 日《Edge AI Daily》相关报道提到 OpenAI 与 Cerebras 的合作,核心指向就是降低对单一路线的依赖,争取更多算力主动权。

这背后很好理解。现在很多团队做的已经不是一次性问答,而是持续执行的 AI 工作流。比如客服质检、营销内容生成、日志分析、代码审查、知识库问答,这些系统一旦接进业务,就不是“偶尔跑一下”,而是全天候请求。请求一多,企业最先感受到的不是模型智商,而是账单、排队时间和峰值时段是否稳定。也正因为这样,算力自建、专用芯片、推理优化和异构架构开始从技术话题变成经营话题。

第二条主线:AI Agent 正在从演示走向企业系统

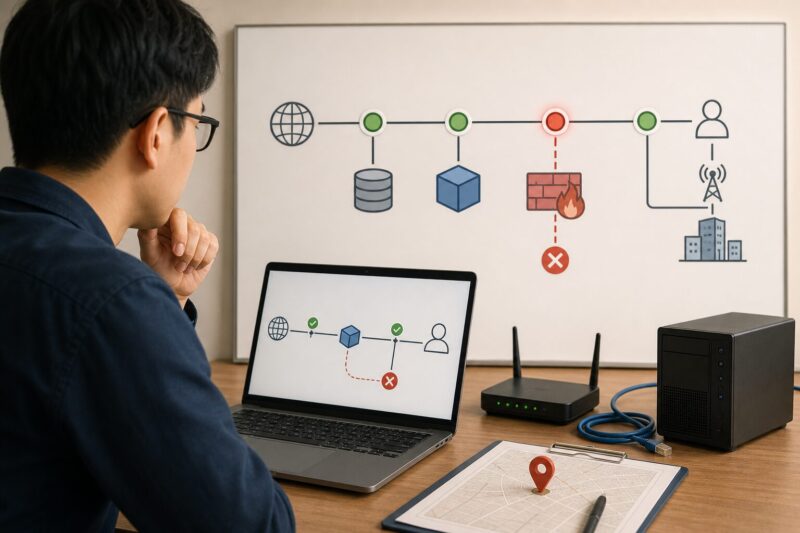

另一条很明显的线索,是“AI 代理”这件事正在快速从概念展示转成企业平台能力。4 月 14 日前后的行业快讯提到,OpenAI 与 Cloudflare 在企业代理落地上的合作继续推进,强调的是让模型不只停留在聊天界面,而是能进入更真实的业务环境,去调用工具、处理流程、连接权限体系和审计机制。4 月 22 日腾讯新闻关于智能体产业图景的专题,也把这个趋势说得更直白:企业现在关注的不是能不能做出一个会说话的机器人,而是能不能让它真的接流程、能交付结果、还能控风险。

这件事对很多中小企业尤其关键。以前不少人觉得“接入 AI”就是买个接口、做个聊天窗口,后来发现真正麻烦的往往不是模型本身,而是接口管理、权限边界、数据源连接、调用链追踪和异常回滚。一个 AI 代理如果能读文档、调系统、改工单、发通知,那它就已经不只是工具,而是半个执行角色。角色一旦进入业务流程,平台层的安全、审计、成本和可维护性就必须跟上。

所以这几天围绕 Agent 的讨论,表面上是在聊新产品,实际上是在逼企业重新审视自己的基础设施。有没有统一 API 层、有没有日志留痕、能不能把内部知识和外部模型隔开、谁能审批高风险动作,这些都不再是“以后再说”的问题,而是上线前就得想清楚的基础条件。

第三条主线:云服务价格与资源价值正在被重新定价

除了模型厂商和代理平台,云服务市场这几天也出现了一个很值得注意的变化。多份 4 月下旬的行业周报和市场观察都提到,随着 Token 调用量持续走高,部分云产品和 AI 相关资源正在进入新一轮价格调整周期。公开报道里提到,云厂商对 AI 算力、容器相关资源和部分大数据服务的刊例价做了上调。这件事对普通用户可能不够直观,但对做应用的人影响很现实:如果推理调用、容器编排、弹性扩缩和存储传输一起涨,最终压力会从云账单一路传到产品定价。

这不一定意味着行业要“变贵到用不起”,但至少说明一个阶段已经过去了。前几年很多平台为了抢市场,会把资源价格压得很低,企业也容易默认云资源会一直便宜、随叫随到。现在当 AI 业务把算力池、网络、存储和调度系统一起拉紧,云资源就开始回归真实成本。谁的架构更省、缓存做得更好、模型分层更清晰,谁就更能扛住价格波动。

对普通企业和站长来说,应该怎么理解这波变化

如果你不是模型厂商,也不是云平台,这波新闻和你有没有关系?其实关系很大。对普通企业来说,过去几天这些消息至少说明三件事。第一,未来一年做 AI 项目,别只盯模型榜单,基础设施和成本模型同样重要。第二,想把 AI 接进业务,重点不再是“会不会聊天”,而是能不能接系统、控权限、留审计。第三,云资源不会永远无限便宜,越早把架构和调用方式理顺,后面越不容易被成本反噬。

对站长、开发团队和中小公司来说,更现实的建议是:先把现有业务链条梳顺,再谈大而全的 AI 计划。比如哪些工作真的适合自动化,哪些请求需要高性能模型,哪些任务可以降级到便宜模型处理,哪些数据必须留在内网,哪些能力适合放在统一网关后面。把这些问题想透,比盲目追新模型更有价值。

综合 4 月 18 日到 4 月 22 日几家公开报道能看到的趋势,这一轮行业变化并不是单点爆发,而是基础设施、平台能力和商业成本在同步重排。短期看,新闻很多、概念很多;长期看,真正留下来的竞争力,还是谁能把算力、代理和成本这三件事一起做顺。下一阶段的 AI 竞争,拼的不只是模型发布速度,更是把能力稳定送进真实业务场景的本事。