谷歌把 Gemma 4 的提速路线摆到了开发者面前:不重训模型、不牺牲输出质量,而是通过 Multi-Token Prediction 推测解码,让同一轮推理尽可能一次预测更多有效 token。对已经在本地设备、企业内网和边缘场景尝试部署大模型的团队来说,这类优化比单纯发布更大的参数规模更现实,因为它直接指向等待时间、硬件成本和可用性。

效率成了新战场

过去的大模型竞争常常围绕参数规模、上下文长度和榜单分数展开,但落到真实部署里,用户最先感受到的往往是响应速度。Gemma 4 的这次优化强调“模型不变、质量不降、速度最高提升 3 倍”,说明开源模型生态正在从单纯追求能力上限,转向更关注推理链路的工程效率。

这对本地 AI 尤其关键。无论是个人电脑、开发者工作站,还是企业内部服务器,算力资源都不可能像云端训练集群那样无限堆叠。如果推理速度能在不额外牺牲效果的前提下提升,许多原本只适合云端调用的场景,就有机会下沉到本地或私有环境中运行。

推测解码的价值

Multi-Token Prediction 的核心意义,是让模型生成文本时不再只盯着“下一个 token”,而是尝试一次预测多个后续 token,再通过校验机制保留可靠结果。这样一来,模型在很多常见输出场景下可以减少迭代次数,用户看到的就是更短的等待时间。

更重要的是,这条路线没有要求开发者更换整个模型体系。对已经围绕 Gemma 系列构建应用的团队而言,推理优化如果能以开源方式接入,就意味着现有工具链、评测流程和部署方案可以继续沿用,只是在性能层面获得更直接的改善。

本地部署更接近实用

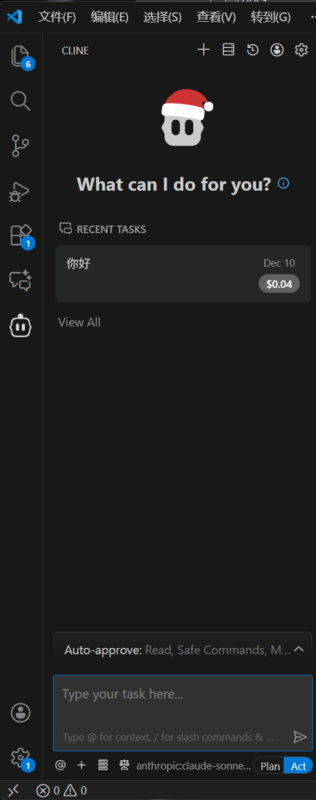

本地模型一直有吸引力:数据不必频繁出域,延迟更可控,成本也更容易预测。但它的短板同样明显,尤其是在长文本生成、代码补全、多轮问答等场景中,响应慢会迅速消耗用户耐心。Gemma 4 这类推理优化如果持续成熟,本地 AI 助手、离线知识库、企业内部 Agent 都会更接近“能常态使用”的状态。

这也会改变开发者选型逻辑。过去很多团队会优先比较模型榜单,现在还要看推理框架、硬件适配、量化方案、上下文缓存和解码策略。模型能力只是基础,真正决定能不能上线的,是整条推理链路能否稳定、快速、低成本地跑起来。

开源生态继续加速

谷歌将相关能力按 Apache 2.0 协议开源,也会给开源社区留下继续改造的空间。开发者可以围绕不同硬件、不同任务类型做更细的优化,把通用模型改造成更适合本地编码、文档处理、客服问答或数据分析的专用工具。

从行业角度看,大模型竞争正在进入更务实的阶段。更强的模型当然重要,但让模型跑得更快、更便宜、更稳定,同样会决定 AI 能否从演示走向日常生产。Gemma 4 的提速信号就在这里:下一阶段的 AI 竞争,不只看谁的模型更聪明,也看谁能把聪明模型真正跑顺。

暂无评论内容