Anthropic 与亚马逊把 Claude 的下一阶段押在了一份极重的基础设施长约上:十年、AWS、5GW 算力,以及最高数百亿美元级别的投资承诺。这条消息比单次模型更新更值得注意,因为它说明大模型竞争正在从“谁的参数更强”进一步转向“谁能长期、稳定、低成本地拿到算力”。

Claude 押注 AWS 算力长约

据 AITNT 资讯,Anthropic 与亚马逊签署十年期 AWS 算力协议,计划锁定 5GW 级别算力用于 Claude 的训练和部署;亚马逊对 Anthropic 的总投资最高可达 330 亿美元,Anthropic 年化营收也已突破 300 亿美元。

这组数字背后的信号很清楚:头部大模型公司已经不只是在买 GPU,而是在提前锁定电力、数据中心、网络、调度系统和云平台能力。未来模型能不能持续迭代,除了算法和数据,基础设施供应链会越来越关键。

AI 竞争进入基础设施阶段

过去一年,模型发布节奏很快,用户感知到的是上下文变长、推理更快、成本下降。但对厂商来说,每一次能力提升都离不开更大规模的训练集群、更高效的推理调度和更稳定的云资源。Anthropic 与 AWS 的绑定,本质上是把 Claude 的增长路径和亚马逊云基础设施深度捆在一起。

这也会改变云厂商之间的竞争格局。谁能提供更确定的 GPU 供应、更低的单位推理成本、更成熟的跨区域部署能力,谁就更容易绑定下一代 AI 应用入口。对企业客户而言,模型能力之外,供应稳定性、服务连续性和调用成本,也会成为选型时绕不开的问题。

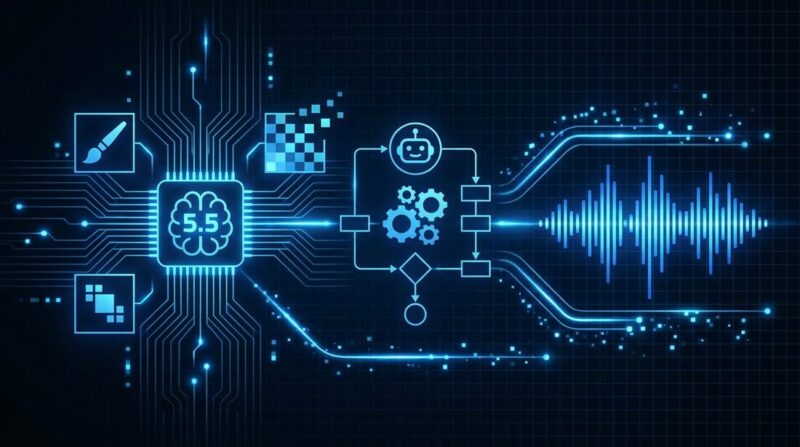

长上下文和推理效率同时升温

同一批资讯里,Subquadratic 发布的 SubQ 也很有代表性。它主打 1200 万 token 上下文,基于新的 SSA 架构,在百万 token 场景下宣称速度提升 52.2 倍,成本仅为 Opus 的 5%。这类方向说明,行业并不只是在堆算力,也在寻找更低成本处理长文本、长任务和复杂工作流的方法。

谷歌为 Gemma 4 推出的 Multi-Token Prediction 推测解码同样指向效率问题:不改变模型、不降低输出质量,却让推理速度最高提升 3 倍,并按 Apache 2.0 协议开源。对开发者来说,开源模型的速度优化往往比单纯参数升级更直接,因为它会影响本地部署、私有化部署和高并发应用的实际成本。

应用层开始争夺入口

基础设施升级的另一端,是应用入口的竞争。Anthropic 客户端中被发现的主动助手 Orbit,目标是从 Gmail、Slack、GitHub 等工具中提取信息,生成个性化工作简报;TRAE SOLO 则在移动端、Windows 桌面端和网页端全量开放,强调多端协同、语音讨论和任务处理。

这说明 AI 助手正在从单一聊天窗口走向更主动的工作流入口。谁能在邮箱、协作、代码仓库、手机和桌面之间建立稳定连接,谁就更可能成为用户每天打开的“AI 工作台”。

企业落地看三件事

对企业和开发团队来说,这些新闻放在一起看,结论并不是“马上追某一个新模型”,而是要同时关注三件事:底层资源是否稳定,推理成本是否可控,应用入口是否能真正接入业务流程。

如果只是做轻量问答,模型能力差距可能不是最大问题;但如果要把 AI 接入客服、知识库、研发、运营或内部自动化系统,接口管理、模型切换、日志审计和成本控制会变得更重要。这个阶段,企业需要的不只是更聪明的模型,也需要更稳的基础设施和更清晰的调用架构。

结语

Claude 与 AWS 的十年长约,把 AI 行业的一条主线摆到了台前:大模型竞争已经进入长期投入阶段。模型发布仍然会吸引注意力,但真正决定产品能否规模化运行的,正在变成算力、云平台、推理效率和应用入口的综合能力。

暂无评论内容