为什么网站会偶发 502 / 504?先查哪里?

网站出现 502 或 504,是很多站长最头疼的一类问题。因为它和“完全打不开”不一样,也和“纯粹变慢”不完全一样。最烦的地方在于,这类错误经常是偶发的:有时候刷新一下就恢复了,有时候某个页面报错,另一个页面又正常,有时候白天没事,到了晚高峰才开始出现。对于用户来说,看到的只是页面报错;对于运维来说,真正麻烦的是这种错误背后的原因并不固定,排查方向很容易一开始就走偏。

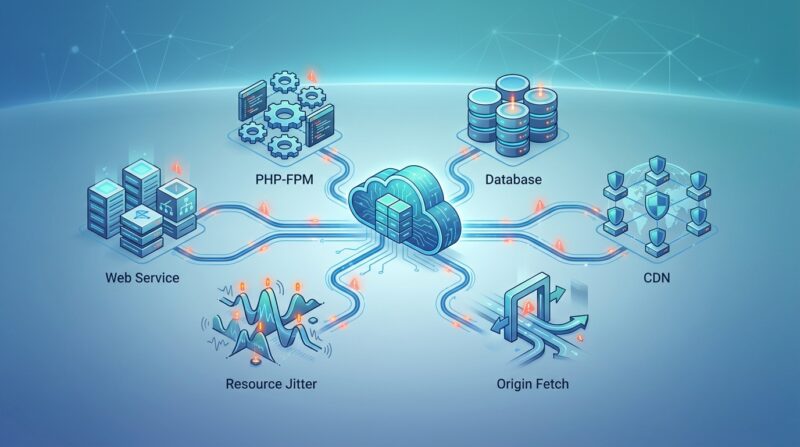

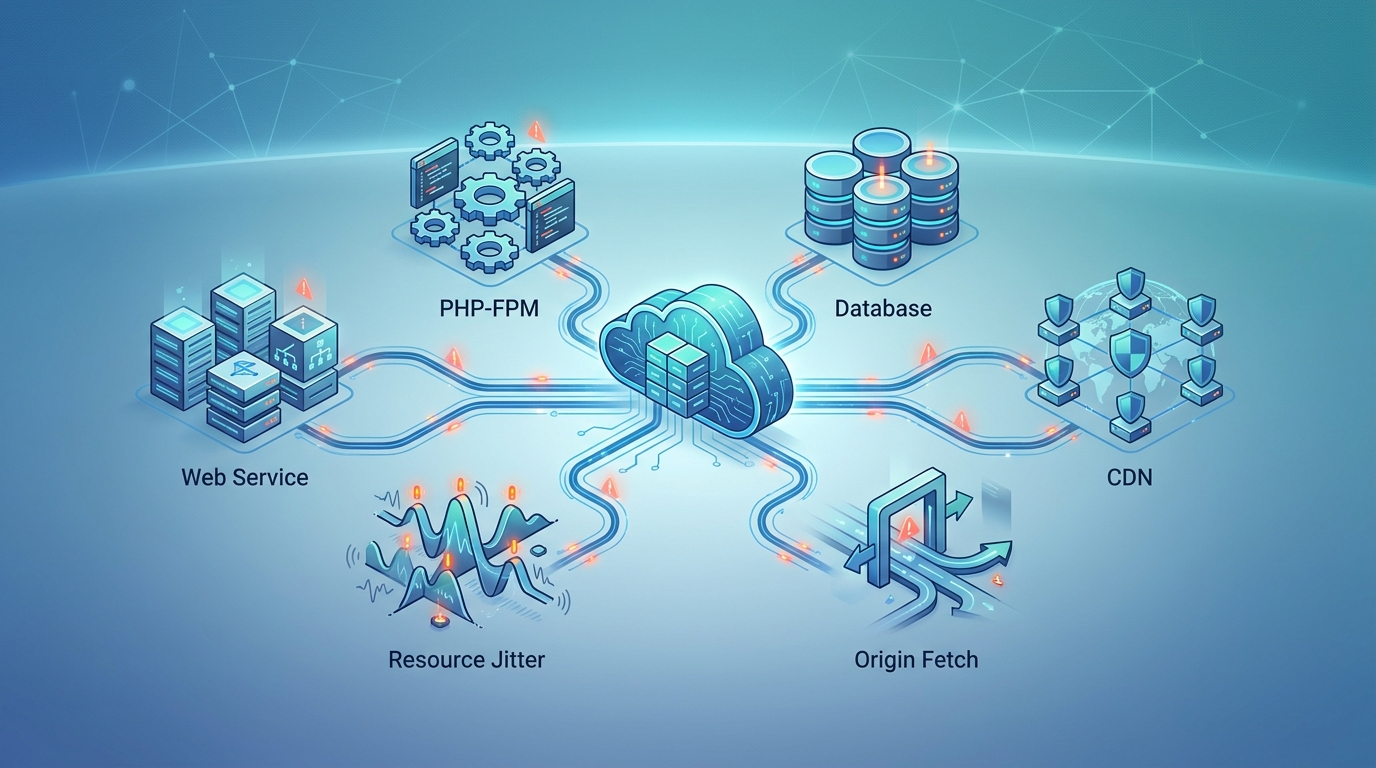

很多人遇到 502 / 504,第一反应会先重启 Nginx、重启 PHP、重启服务器,或者直接觉得配置不够。但实际上,这两类错误虽然都属于“网关相关错误”,问题层级却可能落在完全不同的位置:上游服务没响应、PHP-FPM 堵住、数据库拖慢、反向代理超时、线路波动、CDN 回源异常,甚至缓存和安全策略都有可能把它放大。要想少走弯路,最重要的不是先重启,而是先分清 502 和 504 更像哪一类问题。

先分清:502 和 504 本质上不是同一个问题

如果简单讲,502 更像“上游返回有问题”,504 更像“上游太慢没来得及返回”。也就是说,502 常见于 Web 服务去请求 PHP-FPM、后端应用或反向代理目标时,对方给了异常响应,或者连接本身就没建立成功;而 504 更常见于请求已经发出去了,但在限定时间内,对方一直没把结果返回过来,于是网关层超时。

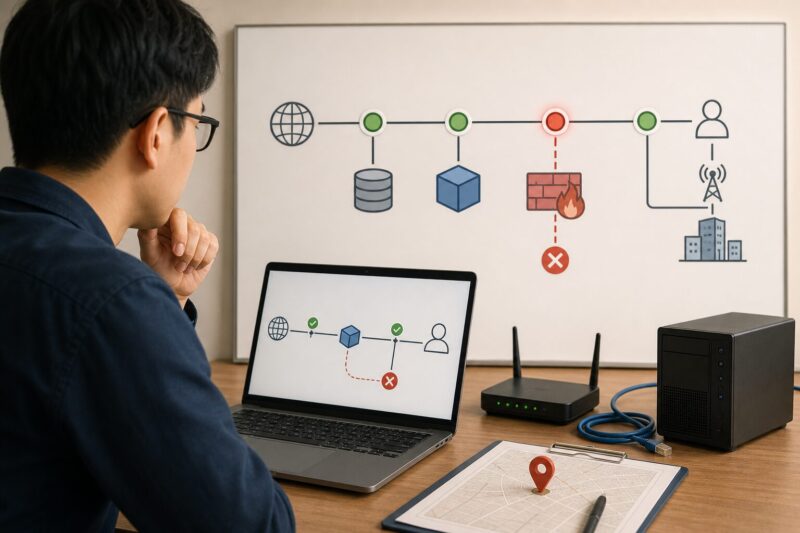

这两个错误虽然用户看着都像“网站坏了”,但真正的排查思路并不一样。502 更应该先去看上游服务是否正常、是否直接报错;504 则更应该先去看为什么请求跑太久、是不是数据库或应用层已经拖慢到了超时边缘。只要一开始能把这层分清楚,后面的方向就会准很多。

第一步:先确认问题是偶发、局部,还是全面爆发

排查 502 / 504 时,第一步不是看配置,而是先看影响范围。因为如果整个站点所有页面都在持续报错,问题通常更偏服务层或环境层;但如果只是某些页面偶发报错、某些时段更明显、某些地区用户反馈更多,那问题就可能在请求链路、数据库查询、回源路径或者线路波动上。

更实用的做法是先确认几个问题:只有前台报错,还是后台也报错?只有提交表单、保存文章、搜索页面会出错,还是首页也跟着出错?是全部用户都有,还是部分地区更明显?这些答案会直接决定你后面先查 Web 服务、数据库,还是先看线路和回源。

第二步:先看 Nginx / Apache 错误日志,不要先猜

502 / 504 这类问题,最怕的就是凭感觉猜。因为它们本来就是网关层把后面的异常“翻译”成一个统一错误码,单看浏览器页面,根本看不出到底是哪一层坏了。这个时候最有价值的,不是重启,而是先去看 Web 服务日志。Nginx 或 Apache 错误日志里,通常能直接给出比较明确的方向:是连接上游失败、是读取响应超时、是 FastCGI 出错、还是后端应用异常中断。

只要先看到日志,你就能把“网站报错”拆成更具体的问题,而不是一直停留在“为什么页面突然 502/504”这个表面层。

第三步:PHP-FPM 和后端应用,是 502 的高发区

如果你的网站本身跑在 PHP 环境里,尤其是 WordPress、宝塔环境、常见 CMS,这类 502 很多时候都会指向 PHP-FPM。比如进程池不够、子进程卡死、配置不合理、脚本执行异常、插件把请求拖崩,都会让 Web 服务在请求 PHP 时拿不到正常结果。这个时候用户看到的是 502,真正的问题却在 PHP 层。

还有一种情况是,网站本身不是纯 PHP,而是后面还有 Node.js、Python、Java 服务,或者其他上游应用。只要这些后端服务异常退出、响应格式不对、端口连接不上,Nginx 一样会报 502。所以如果日志里已经明确指向上游连接失败,就应该优先去看后端进程和运行环境,而不是先怪带宽或线路。

第四步:数据库慢、查询重,是 504 的常见根源

504 这类错误更常见的一种根源,是请求本身跑得太慢。比如页面查询太重、慢查询过多、索引缺失、数据库锁等待、后台保存内容时要处理太多逻辑,最终都可能让请求超过 Nginx、CDN 或上游代理设置的超时时间。结果就是:服务本身不是完全挂了,但就是在规定时间内回不来,于是页面报 504。

这种问题最容易出现在:搜索页、筛选页、评论量大的文章页、后台保存操作、复杂统计页面,以及访问高峰期。因为这些请求比普通首页更重,更容易把数据库和应用层拖到超时边缘。

第五步:偶发 502 / 504,别忘了看磁盘 IO 和资源抖动

很多站长排查这类错误时,只看 CPU 和内存,结果发现似乎都没爆,就以为不是资源问题。但实际上,磁盘 IO、进程队列、连接堆积、短时间内的资源抖动,往往比平均 CPU 更容易制造偶发 502 / 504。因为这些问题不一定持续很久,却足够让某一批请求在那个瞬间失败。

也就是说,服务器不是一直很忙,也照样可能在某个时间点抖一下,然后把用户请求打成报错。所以如果你只看平均监控,很容易误以为资源没问题,实际上真正的问题可能就藏在短时间峰值里。

第六步:如果站点在海外,线路和回源波动也可能放大问题

如果网站服务器放在海外,或者前面接了 CDN、反向代理、WAF,那 502 / 504 还要多看一层:回源和线路。因为有些问题不是应用本身挂了,而是高峰期访问路径不够稳,导致网关层去拉上游数据时偶发失败或超时。表面上看像网站自己抽风,实际上是回程和回源链路先扛不住了。

尤其是面向国内或亚洲访问的网站,这类波动会在晚高峰更明显。站点平时还能用,一到晚上就开始报 502 / 504,这时候就不能只盯着程序本身。像速维云的香港精品大带宽云服务器,会更适合这种既在意网站稳定性,也在意高峰期访问体感的场景;如果只是起步测试站,速维云的香港轻量云服务器也能先跑起来,但一旦业务开始进入真实访问阶段,这类偶发报错就更容易把线路和回源问题暴露出来。

第七步:安全策略、CDN、WAF 也可能制造“看起来像服务器故障”的报错

还有一类特别容易被忽略的原因,是安全层和代理层。比如 CDN 节点回源失败、WAF 误判某些请求、限流规则过严、上游探测异常、源站连接数限制太紧,这些都可能让用户端看到 502 / 504。这个时候你在源站上看,也许服务其实还在,只是外层网关已经先把请求拦住或判超时了。

所以如果日志里源站看起来没什么大问题,但外部访问就是偶发报错,那就一定要回头去看 CDN、WAF、安全组和回源配置。很多“像服务器坏了”的问题,最后并不在服务器本身。

更稳的排查顺序,应该怎么记?

如果你遇到 502 / 504,最稳的顺序通常是这样:先区分 502 和 504 哪个更多;再看 Nginx / Apache 错误日志;接着查 PHP-FPM 或上游应用进程;然后查数据库和慢查询;再补看磁盘 IO 和资源抖动;最后再去看线路、回源、CDN 和安全策略。只要按这个顺序来,通常都会比一上来就重启服务更快定位到真正的原因。

因为这类错误最怕的不是难查,而是你把所有层级都混成一团,最后每一层都碰了一点,却始终不知道真正的问题在哪。

结语:502 / 504 最怕的不是报错,而是你只看到报错页面

用户看到 502 / 504,只会觉得网站坏了;但对运维来说,这只是一个表面结果。真正该看的,是这个错误背后到底是哪一层没正常返回:上游没起来、请求跑太慢、数据库拖住、回源不稳,还是安全层先挡住了请求。只有把这一层拆清楚,后面的处理才不会一直在重启和碰运气之间打转。

所以网站一旦偶发 502 / 504,最稳的处理方式不是先重启,而是先把链路拉直。只要你能把网关、应用、数据库、资源和线路一层层过清楚,这类问题其实多数都能比想象中更快定位下来。