这几天开源 AI 工具链为什么还值得继续盯

如果只看模型榜单,最近几天似乎没有那种“全行业都震一下”的超级新闻;但如果把视角放回开发者和企业真正会用到的工具链,更新节奏其实一点也不慢。过去几天里,Ollama、CrewAI、LangChain 和 LiteLLM 都给出了新的版本动作,而且更新重点已经越来越清晰:不是拼谁喊得更响,而是在拼本地运行体验、Agent 工程化、统一接入层以及安全与治理能力。对准备把 AI 从试玩推进到生产环境的团队来说,这些更新比单纯的参数表更有参考价值。

Ollama:本地推理不只是能跑,更在补齐工具调用体验

从 GitHub Releases 来看,Ollama 在 2026-04-12 发布了 v0.20.6。这个版本里最值得注意的,不只是常规修补,而是继续围绕“本地模型怎么更顺地接入真实工作流”做优化。公开变更里提到,Gemma 4 的 tool calling 能力得到改进并同步了 Google 的后续修复;同时,流式响应里的并行工具调用能力也有提升,桌面应用还修了图片附件相关错误。

这类更新背后的信号很直接:本地推理已经不再只是“把模型下载下来跑通”这么简单。开发者现在更关心的是,本地模型能不能稳定地接工具、接工作流、接应用界面。谁能把这层体验打磨顺,谁就更容易成为私有化测试、边缘部署和离线验证的默认入口。Ollama 这几次连续更新,说明它还在往这个方向持续补强。

CrewAI:Agent 不再只讲故事,开始更重落地和治理

CrewAI 在 2026-04-13 发布了 1.14.2a3。公开更新里提到,它新增了 deploy validation CLI,优化了 LLM 初始化体验,同时还修补了一批和依赖安全、工具 schema 严格模式、Bedrock 工具调用参数保留有关的问题。简单说,这已经不是“再多加一个 Agent demo”的节奏,而是在往可部署、可维护、可验证的工程能力上靠。

这也解释了为什么 Agent 赛道虽然还在分化,但热度并没有降下来。因为企业真正关心的从来不是“会不会多智能体对话”,而是“这个东西能不能上线、上线后好不好管”。当框架开始补部署校验、安全修补和文档体系时,就说明它在向更严肃的使用场景靠拢。CrewAI 这轮更新透露出的,就是这种工程化味道越来越重。

LangChain:基础层还在打磨,重点是稳定性、性能和安全边角

LangChain 这边,langchain-core 1.3.0a2 在 2026-04-13 发布。公开发布记录显示,这一轮更新并不是“花哨大功能优先”,而是继续在底层细节上推进,包括 inherited run trees 的引用计数、模板与路径相关的安全加固、反 SSRF 强化、并行工具调用合并修正、追踪与元数据整理,以及一些性能和依赖更新。

这类变化看起来不如新模型吸睛,但对长期做产品的人反而更重要。因为框架真正拖后腿的地方,很多时候不是你看得见的功能短板,而是链路追踪、序列化、模板安全、工具调用合并这些“平时不显眼,出事就很致命”的基础问题。LangChain 还在高频修这些边角,本身就说明生态还在持续向成熟靠近。

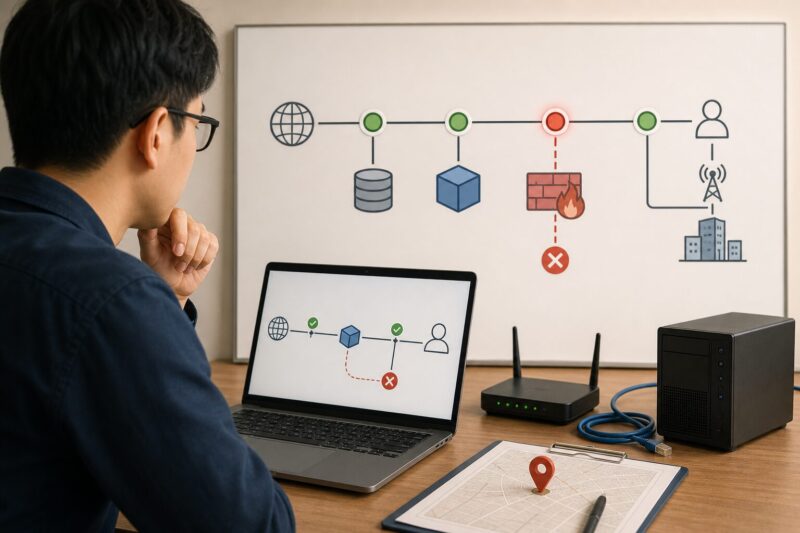

LiteLLM:统一接入层竞争,已经开始卷到安全和治理细节

LiteLLM 在 2026-04-12 发布了 v1.83.7.rc.1。这个版本除了常规功能推进,还特别强调了 Docker 镜像签名校验方式,同时在更新说明里写出了 Prometheus 延迟桶默认值变化这类会影响现有监控面板的 breaking change。除此之外,更新项里还出现了 MCP 相关修复、路径解析加固、管理接口输入校验、权限批量更新、日志与响应处理修复等内容。

这说明统一模型接入层的竞争,已经从“谁支持的厂商更多”升级到了“谁在治理、安全、可审计、可维护上做得更细”。对中小团队尤其如此:很多团队并没有精力分别维护 OpenAI、Anthropic、Gemini、DeepSeek 和各种兼容接口的细碎差异,他们更需要一个足够稳的统一代理层。LiteLLM 这种更新方向,说明它瞄准的已经不仅是接入便利性,还有生产环境里最容易踩坑的治理问题。

这轮信号可以总结成一句话:开源 AI 在比谁更能交付

把这几天的更新放在一起看,会发现一个很明确的趋势:开源 AI 工具链正在从“模型竞争”加速转向“工程竞争”。Ollama 在补本地工具调用体验,CrewAI 在加强部署和安全细节,LangChain 在继续修底层稳定性,LiteLLM 在把统一接入层往治理和生产能力上推进。它们分别站在不同环节,但都在回答同一个问题:AI 怎么才能真正接进现网、接进业务、接进团队的日常流程里。

所以如果现在要判断什么最值得关注,答案已经不只是“下一个更强模型是谁”,而是谁能把本地推理、Agent 编排、统一接入和安全治理这条链路做得更顺。对开发者来说,这决定了试验成本;对企业来说,这决定了上线难度;对内容站点来说,这也比单纯追模型热词更有持续价值。

最后怎么看:比起追概念,更该盯工程节奏

如果你最近还在追开源 AI 动向,这几天最值得看的不是单一模型又拿了多少分,而是这些底层项目有没有继续高频迭代,以及它们在修什么、补什么、强化什么。因为真正把行业差距拉开的,往往不是演示时那几分钟的“惊艳”,而是上线之后几个月里,工具链到底稳不稳、顺不顺、扛不扛折腾。

从目前公开发布记录看,Ollama、CrewAI、LangChain 和 LiteLLM 都在往更可交付的方向推进。对企业用户和开发者来说,这才是更值得长期盯的信号。信息来源为各项目 GitHub Releases 公共发布页面,统计时间截至 2026-04-14。