开源模型的参数规模继续上探

蚂蚁百灵开源 Ring-2.6-1T,把国产大模型的公开竞赛推到了万亿参数量级。它最值得注意的地方,不只是“1T”这个数字足够醒目,而是把可调节推理强度、异步强化学习架构和更高 GPU 利用率放在同一套叙事里:模型能力继续向上冲,训练与推理效率也必须同步优化,否则大参数只会变成昂贵的展示牌。

对开发者和企业用户来说,开源权重上线 Hugging Face、ModelScope 的意义在于,更多人可以直接围绕模型做评测、蒸馏、微调和应用适配。过去,顶级大模型往往被闭源厂商掌握,外部团队只能通过 API 猜测能力边界;现在,国产旗舰思考模型继续开源,会让模型生态里出现更多可复现、可比较、可二次开发的工作。它也会倒逼应用层团队重新思考:到底是直接调用闭源强模型,还是在开源大模型基础上做更可控的私有化能力。

这条新闻放在当前行业背景里看,更像是“模型开源”和“算力效率”同时升温的信号。模型参数越来越大,推理链条越来越长,企业真正关心的却是单位成本下能完成多少任务、延迟能否接受、部署是否可控。可调推理强度之所以重要,是因为它把“聪明”和“省钱”之间的取舍显性化了:简单任务不必每次都拉满推理,复杂任务再使用更重的思考路径。

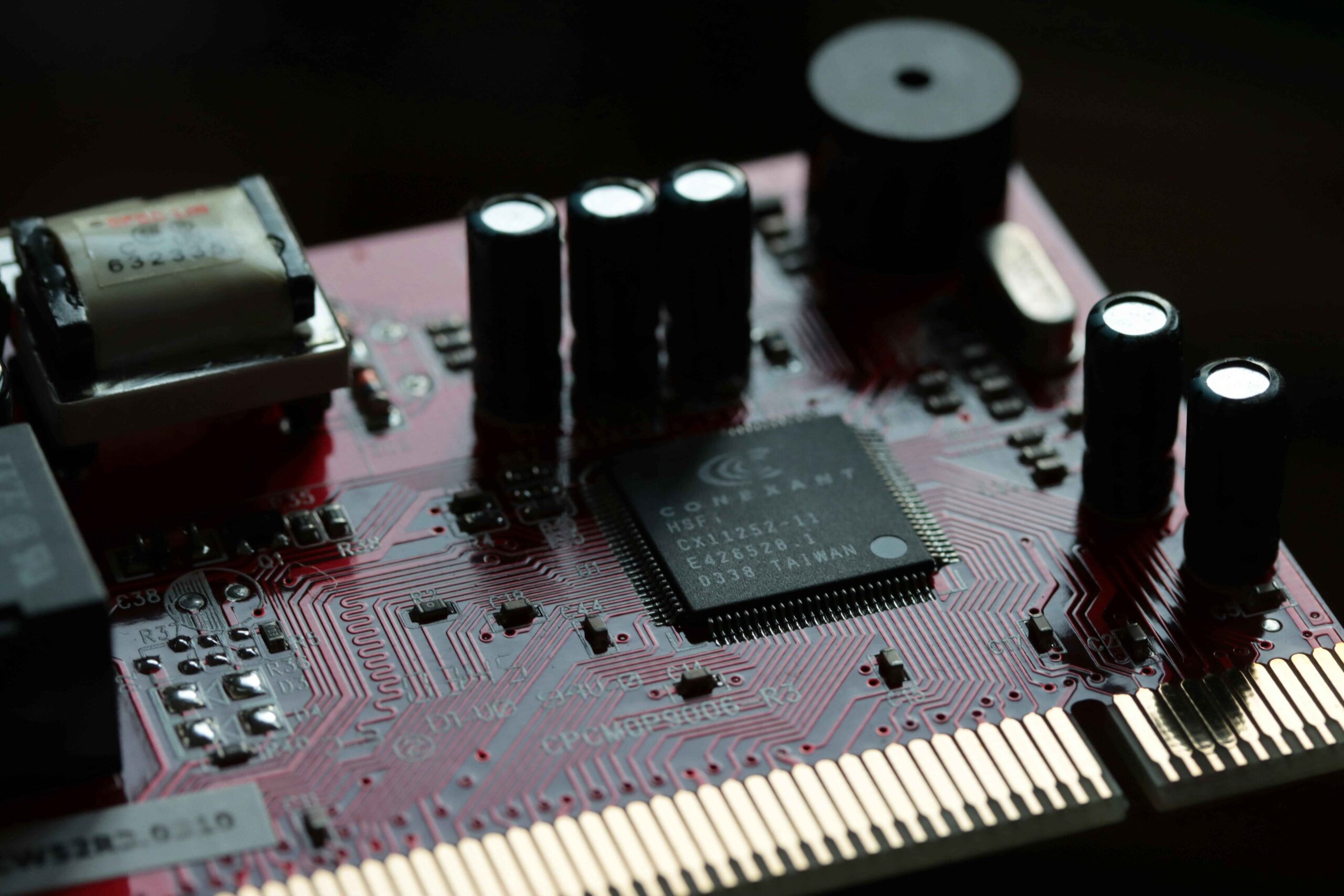

算力通道重新成为竞争焦点

同一天,H200 芯片采购松动、英伟达相关显卡重新上架的消息,也让 AI 产业的注意力再次回到算力供给。大模型能力提升并不是凭空发生的,训练、强化学习、长上下文推理和多智能体协作都离不开高性能 GPU。对国内模型公司而言,先进算力的可获得性会直接影响训练节奏、推理成本和产品迭代速度。

Anthropic 关于美国应在 2028 年前封堵中国获取先进算力和蒸馏美国模型通道的政策文章,则让技术竞争带上了更强的产业政策色彩。一边是硬件采购出现松动,一边是头部 AI 公司呼吁更严格的限制,这种拉扯说明算力已经不只是技术资源,也成了全球 AI 竞争的关键筹码。模型公司拼参数、拼数据、拼算法,背后仍然要回到谁能稳定拿到算力、谁能把算力转化为可持续产品。

对普通企业用户来说,这类新闻看似离业务很远,实际会影响后续模型服务的价格、可用性和稳定性。如果上游算力供给更充足,推理价格可能继续下探,更多高阶模型能力会进入日常产品;如果限制继续收紧,模型厂商就会更强调自研芯片适配、国产 GPU 推理框架和效率优化。摩尔线程 MUSA 合入 SGLang 主线,正是这种背景下的另一条重要线索:国产 GPU 如果能进入主流推理框架,开发者迁移成本会下降,生态才有机会真正跑起来。

编程 Agent 正在从工具变成工作台

模型和算力之外,AI 编程方向的热度仍在继续。xAI 发布首款 Coding Agent Grok Build,阿里 Qoder 1.0 从 AI IDE 升级为智能体自主开发工作台,OpenAI Codex 登陆 ChatGPT 手机 App,这几条消息共同指向一个趋势:AI 编程不再只是编辑器里的补全功能,而是在向“能拆任务、能并行、能跟进进度、能请求审批”的工作流系统演进。

Grok Build 面向高阶订阅用户开放测试,强调并行子智能体和对现有工作流的兼容;Qoder 1.0 则突出多任务并行、团队知识共享、代码保留率提升和 Token 消耗下降;Codex 进入手机端意味着开发任务不再被固定在桌面 IDE 里,用户可以在移动场景查看进度、处理审批、继续推进代码修改。三家公司切入点不同,但目标都很清楚:把 AI 从“写一段代码”推进到“接管一部分开发流程”。

这会改变开发团队的协作方式。未来更关键的问题不是某个模型能不能写出函数,而是它能否读懂现有项目约束,能否在多人协作中遵守代码规范,能否在执行命令、改文件、提交变更时留下可审计记录。企业真正愿意把代码任务交给 Agent,前提是权限、沙箱、回滚、日志和人工审批都足够可靠。否则,AI 写得越快,潜在风险也越容易被放大。

科研、医疗与安全评测进入真实场景

AI 首次在科研竞赛中击败人类的消息,是这批资讯里最有标志性的进展之一。Prime Intellect 实验室用 1.4 万 H200 计算时测试,Opus 4.7 和 Codex 在 nanoGPT 优化任务中刷新人类保持的纪录。它说明大模型和 Agent 结合后,已经可以在特定科研任务里完成长步数探索,而不是只给出论文式建议。

科研场景的价值在于,它天然要求可复现、可验证、可比较。一个模型如果能在公开竞赛中持续提出有效优化步骤,就不只是“会聊天”,而是在接近可交付的研究助手。类似地,上海交大、创智学院、瑞金医院联合发布的 CX-Mind,把胸片诊断推进到可验证推理阶段,也说明医疗 AI 正在从单纯识别结果转向解释链路和医生评估。医疗场景不能只看分数,能不能解释、能不能被复核、能不能融入真实工作流同样重要。

安全领域的进展也值得警惕。微软多 Agent AI 安全系统 MDASH 登顶 CyberGym 黑客能力测试榜首,并发现 Windows 11 高危漏洞;英国 AISI 的测试显示 AI 网络攻防能力正在快速提升。进攻、防守、漏洞挖掘、补丁验证都可能被 AI 加速,企业安全团队会获得更强工具,攻击者同样也会。未来安全竞争不只是“有没有 AI”,而是谁能把 AI 放进更可控的流程里,让自动化能力服务防守而不是扩大攻击面。

机器人与具身智能开始接受现实检验

Figure 公司的 8 小时无预告直播,让具身智能从发布会舞台走向更接近真实的围观场景。3 台搭载 Helix 02 大脑的 Figure 03 机器人自主轮班分拣快递,吸引大量网友观看,重点不在于它是否已经完全替代人类,而在于它敢把连续作业过程放到公众面前接受质疑。具身智能过去常被短视频剪辑和精心演示包装,长时间直播会暴露稳定性、速度、失败恢复和任务泛化能力。

LiberAI 完成多轮融资并研发物理世界模型,原力灵机加码具身智能商业化,香港大学 FASTER 方法缩短 VLA 模型首个动作生成时间,这些消息共同说明机器人方向正在进入“模型能力、硬件本体、数据采集、商业订单”一起推进的阶段。具身智能不是只靠一个大模型就能跑通,它需要视觉、动作、控制、传感器、仿真、真实数据和供应链能力共同配合。

这条线对产业的影响可能比聊天机器人更慢,但更深。仓储分拣、商超补货、工厂搬运、医疗辅助、家庭服务都要求系统长时间稳定运行。只要机器人开始能在部分场景里持续完成简单任务,商业化就会先从高重复、高人力成本、环境相对可控的环节切入。真正的分水岭不是发布一个 Demo,而是能否把故障率、维护成本和部署周期压到客户能接受的范围。

AI 生态也在暴露新的商业与社会问题

苹果与 OpenAI 合作关系紧张的消息,提醒外界:大模型入口合作并不总是双赢。手机系统、超级 App、模型厂商、云服务商之间的利益分配会越来越复杂。谁掌握用户入口,谁掌握模型能力,谁承担推理成本,谁获得订阅收益,这些问题如果谈不拢,合作就可能迅速变成博弈。

Anthropic 调整 Claude 套餐中程序化调用的额度,也让重度 Agent 用户感到压力。对于真正把 AI 接入日常工作流的团队来说,订阅制和 API 计费的边界非常敏感:手动聊天是一种使用方式,自动化任务则可能产生大量调用。模型厂商需要控制成本,用户则希望获得稳定预期,这会推动企业更加重视用量监控、上下文压缩、分层模型路由和任务编排。

同时,AI 带来的社会风险也在持续显现。OpenAI 因旧版 ChatGPT-4o 用药建议卷入人命官司,莫奈真迹被误判为 AI“废画”的舆论事件,则分别指向可靠性和认知偏差两个层面。前者说明医疗、药物、法律等高风险建议必须有更清晰的边界和提醒;后者说明 AI 生成内容普及后,人们对真实作品的判断也会被标签和偏见影响。AI 越普及,越需要建立新的责任分工和媒介素养。

综合来看,这批最新资讯的主线很清楚:模型继续变大,开源继续深入,算力和推理框架成为底座竞争,Agent 从开发工具向工作台演进,机器人、医疗、科研和安全开始接受更真实的验证。AI 行业的热闹不再只集中在一次模型发布,而是分散到基础设施、应用场景、商业模式和社会治理的每一个层面。

暂无评论内容