Anthropic与亚马逊签下长期AWS算力协议,把Claude未来数年的训练、推理和企业部署绑定到更确定的云基础设施上。这条消息之所以重要,不只是因为金额和算力规模足够夸张,而是它把大模型竞争的焦点再次往后推了一层:模型能力当然仍然关键,但谁能拿到稳定算力、谁能把模型接进企业系统、谁能把推理成本和响应速度压下来,正在决定下一阶段AI产品的上限。

同一批重点资讯里,OpenAI继续强化企业部署公司和ChatGPT商业化入口,谷歌围绕Gemma做推理加速,SubQ把长上下文拉到千万级,Luma开放图像模型API,李飞飞团队的AI游戏平台拿到新融资。放在一起看,AI行业正在从“发布一个更聪明的模型”,走向“让模型在真实业务、真实内容和真实基础设施里持续运转”。

Claude锁定云算力

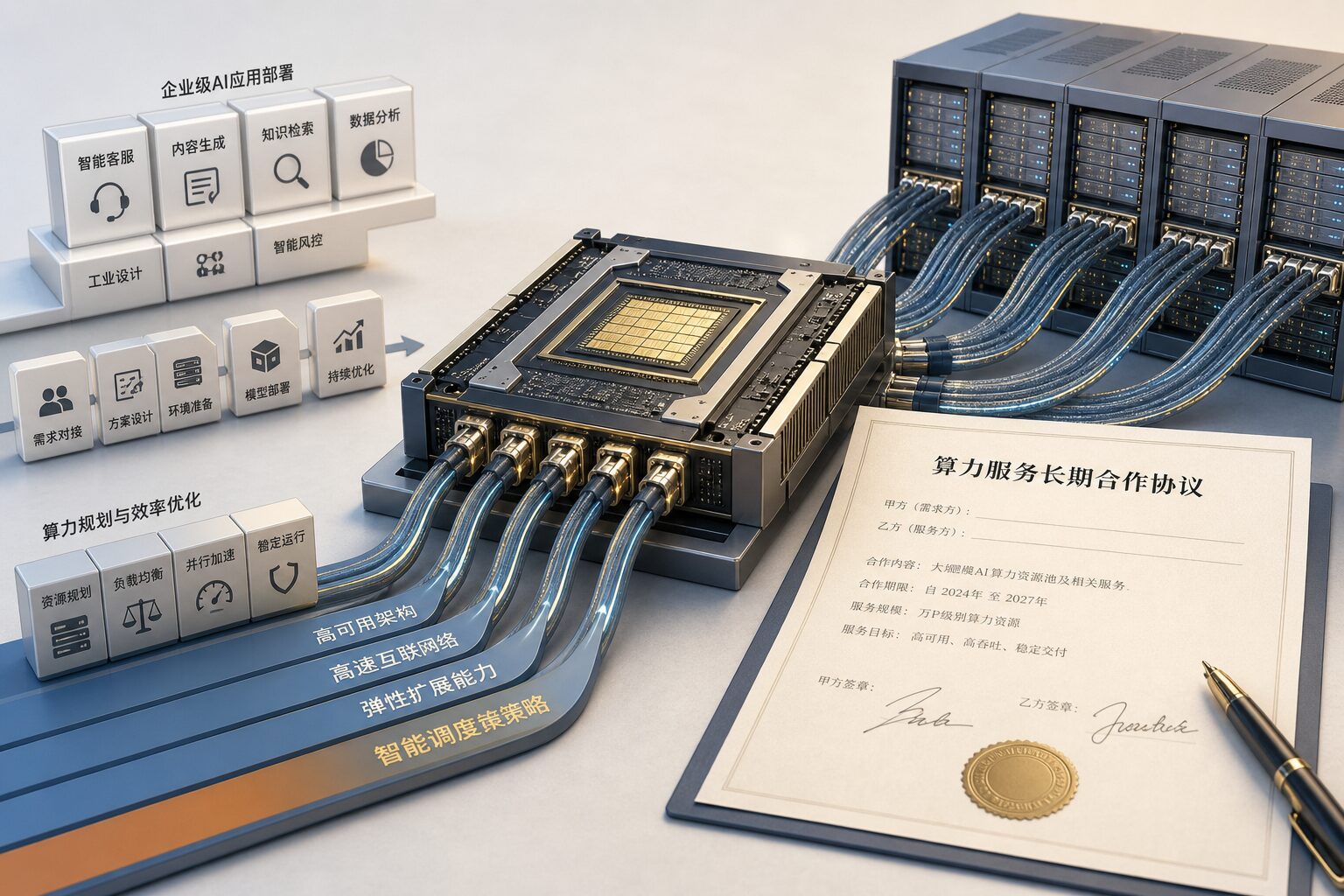

Anthropic与亚马逊的合作,核心看点是长期、巨量、绑定式的算力供给。Claude这类前沿模型不只需要训练阶段的GPU集群,也需要面向海量企业客户和开发者的推理资源。随着上下文窗口变长、多模态能力变强、Agent任务变复杂,推理本身已经不再是轻量调用,而是持续消耗算力的生产系统。

这意味着大模型公司的护城河正在变厚。以前外界更容易用榜单、参数、上下文长度来比较模型,现在还要看模型背后的云资源、芯片供应、调度能力和成本控制。对Anthropic来说,AWS长约带来的是更稳定的底座;对亚马逊来说,Claude则是AWS在AI云服务里的关键需求锚点。

企业用户也会受到影响。大型客户真正采购AI能力时,关心的不只是模型回答是否聪明,还包括服务可用性、数据合规、响应延迟、峰值承载和后续集成。云厂商与模型公司的深度绑定,会让AI服务更像传统云基础设施的一部分,而不是一个单独的聊天产品。

企业部署成为主战场

OpenAI推动企业部署公司的动作,和Anthropic锁定算力并不矛盾,反而指向同一个趋势:AI竞争正在下沉到企业系统里。很多公司已经试过聊天机器人,也接过模型API,但真正困难的部分往往是权限、数据源、业务流程、审计、成本和组织协作。

企业不缺“能回答问题”的模型,缺的是能接入CRM、工单、知识库、代码仓库、财务系统和内部审批流的完整方案。模型厂商如果只停留在API层,容易被集成商、云厂商或垂直软件厂商截走价值;如果深入部署,就能把模型能力变成企业日常工作的一部分。

这一变化对开发者也很现实。未来围绕AI做产品,单纯包装一个对话界面会越来越难形成壁垒。更有价值的方向,是把模型放进具体工作流:让它读取上下文、触发工具、记录结果、遵守权限,并且在失败时能被追踪和修正。

效率比参数更值钱

谷歌为Gemma 4推出的推理加速方案,代表另一个关键方向:不改变模型质量的前提下,让同一个模型跑得更快、更便宜。大模型进入真实业务之后,成本不再是财务表上的小项,而会直接决定产品能不能开放给更多用户、能不能支持更长任务、能不能在本地或端侧运行。

SubQ把上下文窗口拉到1200万token,也把问题推到工程效率层面。长上下文看起来很诱人,但如果每次调用都极慢、极贵,实际可用场景就会收缩。新架构、推测解码、缓存、路由和压缩,都会成为未来模型产品的核心竞争点。

这类技术进展对普通用户未必立刻可见,却会改变AI应用的形态。更快的推理意味着实时语音、代码辅助、移动端Agent和多步骤任务更顺滑;更低的成本意味着免费入口可以承载更多功能;更长的上下文则让模型有机会处理完整项目、长视频、企业文档库和复杂研发资料。

多模态应用继续扩张

Luma开放Uni-1.1 API,并强调图像生成质量、文字渲染、价格和延迟,说明图像模型也在进入工程化竞争。早期图像生成更像创意玩具,用户关注“像不像”“美不美”;现在API开放后,开发者会更关注批量生成稳定性、响应速度、成本、版权风险和与现有内容生产流程的整合。

李飞飞联创的AI游戏公司Astrocade完成新融资,则展示了生成式AI在内容平台上的另一条路线。自然语言生成可玩游戏,把创作门槛从代码、引擎和美术资产,进一步降到创意描述和交互设计。这类产品如果能形成用户社区和分发机制,就不只是工具,而可能成为新的UGC内容平台。

字节、阿里等团队在多模态模型、奖励信号和世界模型方向的进展,也说明视觉生成正在从单张图片扩展到视频、3D场景、交互世界和训练数据闭环。未来AI应用的竞争,不会只发生在文本助手里,游戏、短视频、广告、电商、教育和工业仿真都会被卷进去。

Agent走向协作层

Claude Orbit的曝光、TRAE SOLO三端开放、Multica这类多Agent协作项目受到关注,都说明AI助手正在离开单一聊天框。用户真正想要的不是“问一句答一句”,而是让AI主动汇总信息、拆解任务、调用工具、跨设备继续工作,并在合适的时候把结果交还给人。

这会带来新的产品入口之争。桌面端、移动端、浏览器、IDE、企业IM和云端任务队列,都可能成为Agent的运行位置。谁能更自然地拿到用户上下文,谁就更容易把AI变成日常工作流的一部分。Claude、Codex、TRAE、DeepSeek TUI等工具被频繁比较,本质上是在争夺开发者和知识工作者的工作台。

但Agent越主动,安全和可控性越重要。读取邮件、代码仓库和企业文档,意味着权限边界必须清晰;自动执行任务,意味着日志、回滚和审批机制不可缺位。未来好用的Agent平台,不能只强调“能做事”,还要让用户知道它做了什么、为什么这么做、出了错如何处理。

机器人与具身智能升温

具身智能方向也有多条消息值得关注。RoboScience机器科学获得大额融资,高少龙再创业聚焦具身数据服务,触觉数据集和VTLA框架受到讨论,软银也被曝计划用自主机器人参与数据中心建设。这些资讯共同指向一个事实:机器人正在从炫技演示走向数据、场景和工程交付。

过去机器人公司常被质疑“视频很酷,落地很慢”。现在行业开始补齐更底层的环节:高质量具身数据、仿真训练、任务评估、硬件本体、触觉反馈和真实场景部署。尤其是数据中心建设、仓储、制造、养老陪伴等场景,如果能形成稳定需求,机器人公司就更容易从实验室走向商业化。

不过,波士顿动力相关高管流动和产能压力也提醒行业,机器人不是只靠模型突破就能解决的问题。硬件可靠性、供应链、成本、维护和安全责任,都比纯软件产品更重。具身智能的机会很大,但它的商业化节奏可能比大模型聊天产品更慢、更复杂。

热闹之外的商业化压力

OpenAI广告主平台、ChatGPT免费模型升级、AI产品海外收款、少儿AI营销、AI音乐节等消息,让行业多了一些热闹和烟火气。免费用户入口需要商业模式支撑,广告、订阅、企业部署、API调用和生态分成都可能并存。问题在于,AI产品一旦引入广告或强商业化,就要重新处理用户体验和信任边界。

少儿AI营销和AI生成音乐节则说明,AI已经进入大众文化和消费市场。它可以降低创作门槛,也可能放大焦虑和噱头。对普通用户来说,判断一个AI产品是否值得用,越来越不能只看宣传里的“智能”,还要看它是否真的解决问题、是否透明、是否尊重用户的时间和钱。

综合这些重点资讯,AI行业的主线已经很清楚:模型能力仍在进步,但真正的竞争正在围绕算力、成本、企业交付、多模态内容、Agent工作流和具身场景展开。谁能把这些环节串成稳定产品,谁才更有机会从热闹发布会走到长期收入。

暂无评论内容