Claude 把未来十年的算力押给 AWS,OpenAI 又把企业部署公司、免费模型升级和实时语音架构摆到台前,这几条消息放在一起看,AI 行业的竞争重心已经很清楚:谁能把模型稳定、低成本、低延迟地送进真实业务,谁才有机会拿到下一阶段的入口。

算力长约成了新护城河

Anthropic 与亚马逊签下十年级别的 AWS 算力协议,核心看点不只是金额巨大,而是它把 Claude 的训练、推理和企业服务能力长期绑定到云基础设施上。大模型公司过去比的是参数、榜单和发布节奏,现在越来越像一场供电、机房、芯片和网络调度能力的综合竞赛。训练大模型需要集中算力,服务数千万乃至数亿用户则需要稳定推理容量,任何一端跟不上,产品体验都会被延迟、排队和成本拖住。

这也解释了为什么云厂商愿意继续加码。对亚马逊来说,Anthropic 不只是一个模型客户,更像是 AWS 在 AI 时代证明自身基础设施价值的标杆案例。模型公司需要长期可预期的算力供给,云厂商需要足够重量级的 AI 客户锁定需求,两边的关系正在从采购合同变成战略同盟。未来用户看到的可能只是 Claude 回答更快、上下文更长、工具调用更稳,但背后真正决定体验的,是数据中心、GPU 集群、网络互联和调度系统能不能撑住。

OpenAI 把企业落地推到前台

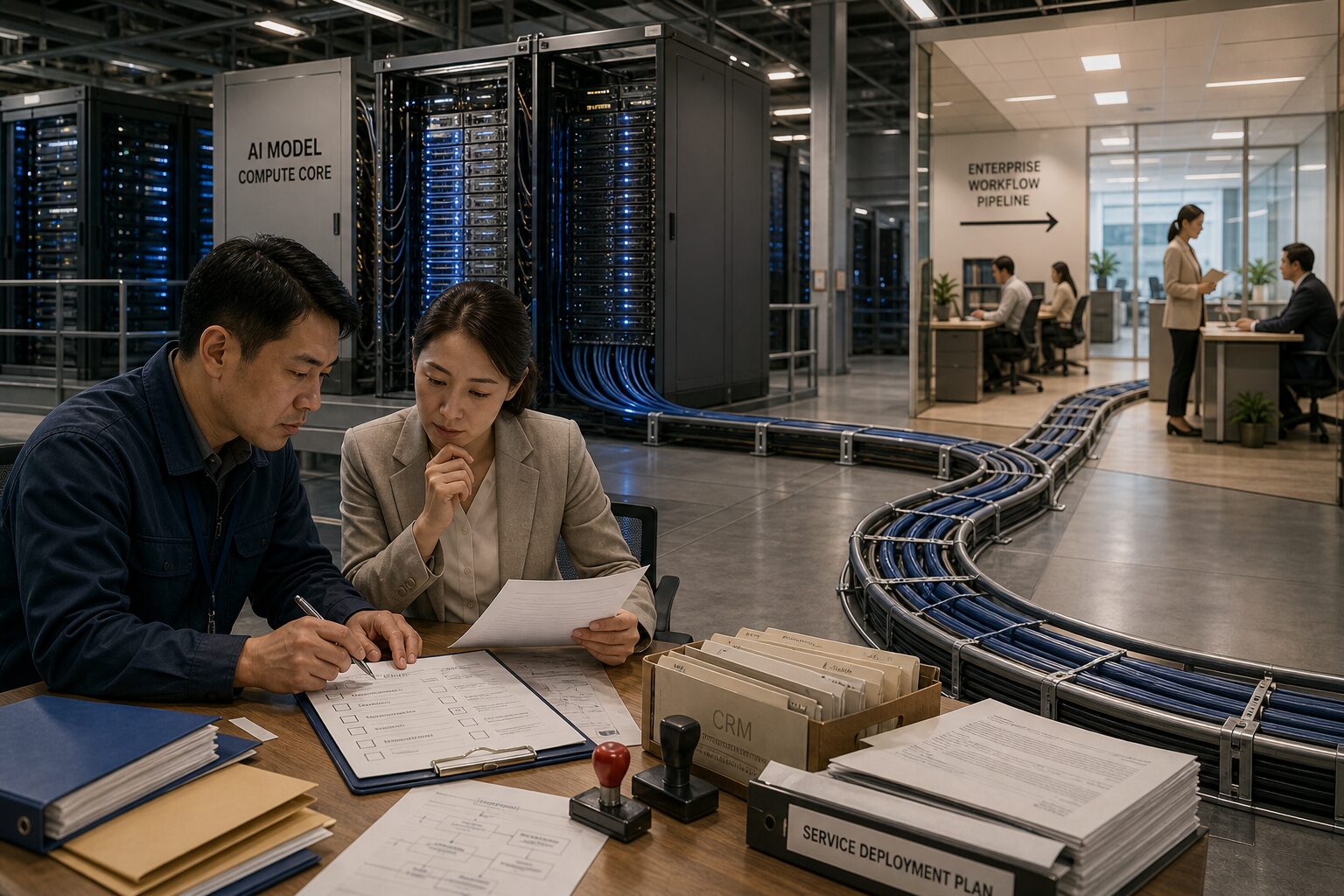

OpenAI 成立 The Deployment Company 的信号同样明确:企业 AI 的难点,已经从“有没有足够强的模型”转向“能不能接进真实业务”。一个模型 API 再强,如果无法处理企业内部权限、数据边界、审批流程、系统集成和成本治理,就很难从演示走向规模化使用。OpenAI 选择用独立部署公司承接企业落地,说明它正在把咨询、集成、交付和持续运营看作模型商业化的一部分。

这对企业用户也提出了新的判断标准。采购 AI 能力时,不能只看模型基准分数,还要看供应商能否给出稳定的调用接口、清晰的数据处理规则、可审计的日志、可控的费用上限,以及与现有 CRM、工单、知识库、研发系统之间的衔接能力。很多企业最初以为 AI 项目失败是模型不够聪明,真正落地后才发现,卡点往往在业务流程没有梳理、数据权限没有打通、员工不知道如何嵌入日常工作。

ChatGPT 免费模型升级和广告主平台上线,也让 OpenAI 的商业路径更清晰。一方面,免费入口需要持续提升基础体验,降低幻觉、增强记忆、优化回答风格,让更多用户形成使用习惯;另一方面,广告、企业订阅和部署服务会逐渐分层,免费用户、专业用户和企业用户看到的产品形态可能越来越不同。AI 产品不再只是一个统一聊天框,而会沿着个人效率、企业流程、营销入口和开发工具等方向分化。

推理效率正在决定产品边界

谷歌为 Gemma 4 推出 Multi-Token Prediction 推测解码,让本地和端侧大模型获得更高推理速度,这类消息看似偏技术,实际会直接影响产品形态。推理效率提升意味着同样硬件可以服务更多请求,或者在更小设备上实现更流畅交互。对开发者而言,这会降低试错成本;对终端用户而言,则可能带来更快的本地助手、更低延迟的语音交互,以及更少依赖云端的隐私场景。

Luma 开放 Uni-1.1 API 也体现了同一趋势。图像模型不再只拼“能不能生成漂亮图片”,而是开始拼价格、延迟、文字渲染、接口稳定性和规模化调用能力。对内容生产、广告、电商、游戏素材和设计工具来说,模型质量当然重要,但如果单张生成成本过高、等待时间太久、文字渲染不稳定,就很难进入高频工作流。AI 生成内容的下一步竞争,会从炫技作品转向可重复、可控、可批量生产。

Agent 从聊天窗口走向工作现场

Claude 未发布主动助手 Orbit 的泄露信息值得关注,因为它代表了 AI 助手形态的变化:不再只是用户提问后被动回答,而是主动读取 Gmail、Slack、GitHub 等信息,生成个性化工作简报。若这类能力正式落地,AI 助手会更像一个跨应用的信息中枢,帮助用户整理待办、识别风险、汇总项目进展,并在合适时间提醒下一步动作。

TRAE SOLO 三端开放则说明 Agent 正在离开单一桌面场景。移动端、Web 端、桌面端协同之后,用户可以在手机上发起任务,让 Agent 在云端或电脑上继续执行。真正有价值的 Agent,不只是会聊天,而是能跨设备、跨工具、跨时间持续推进任务。开发者工具、办公协作、客服运营、数据分析和内容生产都会受到影响,因为这些场景都有大量“需要连续处理但不必人类一直盯着”的工作。

不过,主动型 Agent 也会带来权限和信任问题。它要读取邮件、代码仓库、即时通讯和文件系统,就必须证明自己不会误删、误发、泄露敏感信息,也不会在用户没有确认的情况下执行高风险操作。未来 Agent 产品的关键能力,可能不是“更像人”,而是“更可控”:哪些数据能读、哪些动作要确认、哪些日志可追溯、出错后如何回滚,这些机制会决定企业和个人是否敢把真实工作交给它。

长上下文与新架构继续改写成本结构

SubQ 这类超长上下文模型的出现,把注意力再次拉回模型底层架构。1200 万 token 上下文如果能以更低成本稳定使用,会改变很多知识密集型场景的工作方式,例如法律材料审阅、科研文献整理、代码仓库理解、企业历史工单分析和大型项目文档检索。过去很多系统需要先切片、建索引、做复杂检索增强,长上下文能力提升后,开发者可以在部分场景里采用更直接的上下文注入方式。

但长上下文不是万能解。上下文越长,越考验模型的信息定位、注意力分配和事实一致性,也越考验成本控制。企业真正需要的不是把所有资料塞给模型,而是让模型在合适的资料范围内稳定完成任务。新架构如果能同时降低成本、提升速度并保持质量,就会推动更多复杂任务进入 AI 工作流;如果只是把窗口做大,却无法保证可靠性,用户仍会回到检索、摘要和分层推理的组合方案。

应用层开始出现更多真实需求

李飞飞联创的 Astrocade 获得大额融资,说明 AI 游戏和互动内容仍是资本关注的方向。它的价值不只是“用一句话生成游戏”,而是降低普通人制作可玩内容的门槛,让创意、社交传播和轻量互动结合起来。生成式 AI 如果只产出静态文本或图片,想象空间有限;一旦进入游戏、虚拟世界和可交互场景,就可能带来新的内容生态。

医疗方向同样在持续推进。DeepMind 负责人强调 AI 改善人类健康的价值,AlphaFold 对蛋白质结构预测的影响已经说明,AI 在科学研究中最有潜力的部分,不是替人写几段文字,而是帮助人类理解更复杂的现实系统。药物研发、基因研究、新材料发现都需要跨越海量数据和复杂假设,AI 可以成为科学家的加速器,但这类场景也要求更高的可解释性、验证流程和安全边界。

机器人和具身智能领域则继续升温。从触觉数据集到机器人融资,从数据中心建设机器人到情感陪伴机器人,行业正在寻找 AI 从屏幕走向物理世界的路径。与纯软件不同,机器人必须面对传感器、机械结构、环境变化和安全风险,落地速度不会像聊天产品一样快。但一旦具身智能在工业、养老、物流、巡检等场景跑通,AI 的影响范围会进一步扩大。

用户会看到更快的 AI,也会看到更贵的 AI

这些消息共同指向一个现实:AI 服务会越来越强,也会越来越分层。免费模型会继续升级,以维持入口和用户习惯;企业级能力会围绕安全、权限、部署和集成收费;高性能生成、多模态、长上下文和低延迟语音则可能形成更细的价格档位。用户感知到的是功能变多,行业内部面对的是算力、能源、芯片和工程团队成本持续上升。

苹果调整 Mac mini 入门配置的消息虽然看起来是硬件产品变化,但也折射出 AI 带来的供应链压力。更大的内存、更高的存储、更强的本地推理能力,都会成为设备的新门槛。所谓“AI 税”并不一定以订阅费形式出现,也可能体现在硬件价格、云服务价格、企业部署成本和使用限制上。

接下来一段时间,AI 行业的主线很可能不是某个模型单点领先,而是模型、算力、工具、企业交付和终端设备共同重组。真正值得关注的公司,不仅要会发布模型,还要能把模型变成稳定服务;不仅要有技术突破,还要能让用户在真实场景中持续用下去。AI 竞争进入基础设施与落地并重的阶段后,热闹的发布会会继续出现,但长期胜负会在成本、速度、可靠性和用户留存里慢慢显现。

暂无评论内容